Deepfake; ein Fake, der in die Tiefe geht? In gewisser Weise stimmt das tatsächlich. Denn mit dieser Technologie generieren künstliche Intelligenzen eigenständig Gesichter oder tauschen in existenten Fotos und Videos Gesichter und Stimmen von Personen aus.

Was Deepfakes noch alles können und welche Gefahren sich hinter ihnen verbergen, erfahren Sie hier!

Unser Beitrag über Deepfakes im Überblick:

Was ist ein Deepfake?

Während der auf dem Englischen kommende Begriff Fake (für „Fälschung“) schon länger im deutschen Sprachraum etabliert ist, erschließt sich doch nicht unbedingt intuitiv, was ein Deepfake sein soll. Fangen wir beim ersten Wortteil an: Der englische Begriff deep bedeutet zwar direkt übersetzt „tief“, verweist in dieser Verwendung aber vor allem auf Deep Learning. Das ist eine Lernmethode, mit der eine künstliche Intelligenz (KI) komplexe Methoden selbstständig verstehen kann. Und mithilfe von entsprechenden Deep-Learning-Prozessen kann KI beim Deepfaking eben genau das Faking lernen. Maschinen können konkret Gesichter und Stimmen erkennen und zuordnen, um sie dann im nächsten Schritt komplett selbstständig und zum Teil mühelos auszutauschen.

Das Beispiel des Deepfaking wird oft herangezogen, um zu zeigen, wie weit künstliche Intelligenz heute schon ist. Es zeigt uns, dass wir in mancher Hinsicht viel weiter sind, als wir oft wahrnehmen. In Form von Deepfaking kann Medienmanipulation so präzise betrieben werden, dass es keine Möglichkeit gibt, die Medien als gefaked zu entlarven.

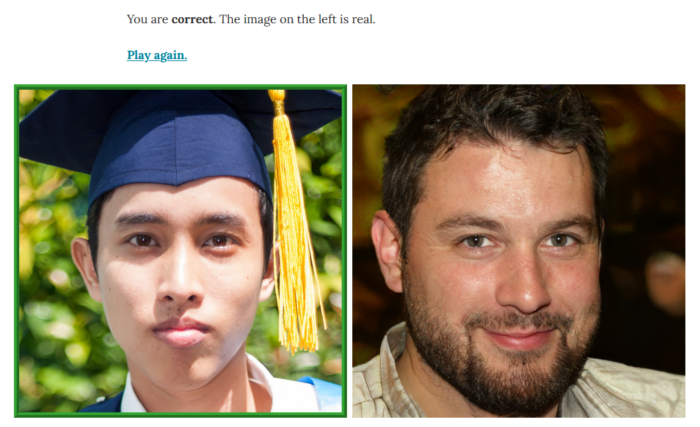

Das sind keine tatsächlichen Fotos sondern von StyleGAN generierte Deepfakes. Die Personen existieren in Wirklichkeit gar nicht. Bilder: https://thispersondoesnotexist.com/

Deepfakes von StyleGAN

Was komplexere fotografische Deepfakes sind, sieht man gut auf der Seite https://thispersondoesnotexist.com/. Besucht man sie, kann man sich einen individuellen Deepfake generieren lassen. Dieser wird vom generativen Netzwerk StyleGAN erzeugt. StyleGAN ist von dem Grafikkartenhersteller Nvidia entwickelt worden und arbeitet mit der Nvidia-Software CUDA, GPUs und basiert auf TensorFlow. Auf den ausgegebenen Fotos der Website sieht man Gesichter, die von künstlicher Intelligenz geschaffen wurden und die es in Wahrheit also gar nicht gibt.

Auf ähnliche Weise funktioniert die Website https://generated.photos/. StyleGAN ist eine Datenbank mit rund drei Millionen computergenerierten Gesichtern. Basis für ihre Erstellung ist ein privater Datensatz. Gerichtet ist die Datenbank vor allem an Unternehmen, die Stock-Fotos benötigen, aber sehr individuelle Vorstellungen haben, wie die dargestellte Person aussehen sollte. Die nicht kommerzielle Nutzung der Bilder ist kostenlos.

Die University of Washington nutzt StyleGAN übrigens für das Projekt Which Face Is Real. Nutzer entscheiden in Form eines Spiels, welches von zwei Gesichtern echt ist. Eines der Gesichter wird stets mithilfe von StyleGAN, also von einer künstlichen Intelligenz, generiert. Heute fällt es uns bereits erschreckend schwer, computergenerierte Gesichter von echten zu unterscheiden. Und genau das will das Projekt aufzeigen: Im Fokus steht die Sensibilisierung, wie leicht es für Kriminelle ist, sich als Personen auszugeben, die gar nicht existieren. Im Jahr 2019 entfernte Facebook ganze Profilnetzwerke von Spam-Bots und gab bekannt, dass es sich dabei um Profile handelte, die Deep Fakes als Fotos genutzt hätten. Durch Deepfakes fällt es auch Algorithmen zunehmend schwerer, Spam-Bots klar als solche zu identifizieren.

Ein Deepfake zu erkennen, ist manchmal gar nicht so einfach. Können Sie echte Gesichter von Fakes unterscheiden? Screenshot: https://www.whichfaceisreal.com/

Faceswapping

Während StyleGAN Gesichter komplett neu zusammensetzt, wird Deepfaking meistens aber mit dem sogenannten Faceswapping (auch Face Swapping) in Verbindung gebracht. Hierbei wird das Gesicht einer Person in Fotos oder Filmaufnahmen durch das Gesicht einer anderen Person ausgetauscht. Die KI analysiert dazu möglichst viele Daten beider Personen, um sich mit jeder Eigenheit des Gesichts vertraut zu machen. Das ist ihr meistens ein Leichtes, denn von fast jedem gibt es heute im Internet eine Fülle an Videos und Fotos zu finden. Besonders dann, wenn die- oder derjenige auch Person des öffentlichen Interesses ist. Bekannt geworden ist Faceswapping durch die sogenannte FakeApp.

Das erste Mal wurde ein Deepfake 2017 öffentlich bekannt. Ein User der Social-News-Plattform Reddit lud Pornos hoch, bei denen er die Gesichter mit denen von Schauspielern und Schauspielerinnen einsetzte. Bis 2018 haben alleine in Reddit Benutzer mehr als 50.000 mit Faceswapping erstellte Deepfakes veröffentlicht. Auf dieser und den meisten anderen Plattformen sind solche Videos oder Bilder jetzt aber ausdrücklich verboten. Dennoch ist meistens gar nicht kontrollierbar, ob ein Video oder Foto echt ist oder nicht.

Voiceswapping & Body-Puppetry

Voiceswapping (auch Voice Swapping) ist das Equivalent zum Faceswapping und ersetzt die Stimme einer Person mit der einer anderen. Analysen von Datensätzen können sprachliche Eigenheiten auswerten und entsprechend lernende KI kann trainieren, sie haargenau zu imitieren. Sogenanntes Body-Puppetry überträgt bestimmte Bewegungen auf bestehendes Videomaterial einer anderen Person. Da die KI hierbei in der Lage sein muss, den Hintergrund authentisch zu rekonstruieren, gilt diese Form des Deepfakings heute noch als am kompliziertesten.

Eines der wohl bekanntesten Beispiele für eine Kombination zum Faceswapping und Voiceswapping kommt von der US-Organisation Represent US. Zur vergangenen Präsidentschaftswahl 2020 hat sie Deepfakes veröffentlicht, in denen die Gesichter und Stimmen von Darstellern mit denen von Machthabern wie Putin ersetzt wurden. Ziel der Kampagne war es, ein Bewusstsein für die Medienmanipulation zu schaffen, aufzuzeigen, wie professionell Fake News aussehen können und einen klaren Appell für die Teilnahme an einer jeden demokratischen Wahl auszusprechen. Auf YouTube kann man sich die entsprechenden Videos auch jetzt noch ansehen. In diesem Video sieht man eine fingierte Ansprache von Kim Jong-Un:

Gefahren durch personenbezogene Deepfakes

Deepfaking birgt viele zum Teil ernstzunehmende Gefahren. Es gibt nicht zuletzt deswegen auch bereits eine breite Debatte in der Politik, ob Deepfaking eine Gefahr für Wirtschaft, Gesellschaft und das soziale Miteinander darstellt. Unter anderem wurde in diesem Diskurs auch die konkrete Idee ausgesprochen, das unerlaubte Generieren und Verbreiten von Deepfakes generell unter Strafe zu stellen. Immerhin finden sich die meisten Deepfakes in den Bereichen der Pornografie und des Wirtschaftsbetrugs.

Schaut man sich konkrete Entwicklungen des Deepfaking an, kann man diesen Vorschlag auch durchaus nachvollziehen: DeepNude war beispielsweise eine im Jahr 2019 veröffentlichte Software, bei der eine KI in der Lage war, die Kleidung von Frauenbildern zu entfernen. Heute ist die Software zum Glück nicht mehr legal verfügbar, kursiert wahrscheinlich aber immer noch in den Weiten des Internets. Wie gefährlich Deepfakes jedoch tendenziell seien können, kann man sich mit dem Wissen, dass es solche Programme schon gibt, ausmalen. Was denken Sie über Deepfakes im Generellen und was darüber, wie sie genutzt werden? Glauben Sie, dass ein Verbot angemessen wäre? Schreiben Sie Ihre Meinung gern in unsere Kommentarspalte.

Deepfake-Angriffe

Dass Deepfaking aber nicht nur für fiese – und definitiv grenzüberschreitende – Streiche genutzt werden kann, zeigt der Seitenblick auf die Gesichts- und Stimmerkennung. Bisher galt sie noch als ziemlich sicher, kann mit Deepfaking jetzt jedoch ohne Weiteres ausgetrickst werden. Mithilfe von Faceswapping und Voiceswapping können Kriminelle dabei Gesichtserkennung und Spracherkennung umgehen. Den Einsatz von Deepfakes für klare und zielgerichtete Attacken gegen Gesichts- und Stimmerkennungsprogramme nennt man Deepfake-Angriffe. Unter anderem setzen Banken Videoverifizierungen ein, die Kriminelle ebenfalls problemlos bestehen könnten.

Mithilfe von Zwei-Faktor-Authentifizierung können Sie solchen Betrügereien jedoch zumindest entgegenwirken. Um Zugang zu Ihren Geräten oder Daten zu erlangen, müssten Kriminelle dann nicht nur Deep Fakes einsetzen, die Ihr Gesicht und Ihre Stimme imitieren, sondern beispielsweise auch Buchstaben- und Zahlencodes kennen.

Deepfaking und Social Engineering

Sowohl Firmen als auch Privatpersonen sollten sich aktiv vor Deepfakes schützen. Angreifer können Deepfakes nämlich nicht nur für reine Deepfake-Angriffe nutzen, sondern sie auch in Rahmen von verschiedenen Social-Engineering-Angriffen einsetzen. In Form von sogenannten Spear-Phishing-Attacken können Kriminelle dabei vorgeben, Personen aus dem Umfeld der Angegriffenen zu sein, um an deren sensible Daten wie Konto- oder Zugangsdaten zu gelangen.

Um es konkreter zu machen: Ein Anruf vom Chef ist doch deutlich glaubwürdiger, wenn der Anrufer die echte Stimme des Chefs hat. Bei Videocalls setzen Social Hacker Deepfakes ein, um ihre Gesichter mit denen von anderen Personen auszutauschen. Dann, wenn Sie glauben, Ihren Vorgesetzten zu hören und zu sehen, vertrauen Sie auch auf die Richtigkeit des von ihm Gesagten.

Deepfaking-Angriffe nutzen die Imitation von Gesichtern und Stimmen realer Personen aus. Bild: Pixabay/geralt

Wie Sie sich schützen können

Da Kriminelle Deepfakes vor allem einsetzen, um individuelle Zugangsbeschränkungen zu umgehen oder Personen von der eigenen Authentizität zu überzeugen, gibt es keinen einheitlichen Schutz gegen entsprechende Angriffe. Dennoch haben wir einige Tipps zum Schutz vor Deepfake-Angriffen:

- Unternehmen aller Größen sollten klare Richtlinien erstellen, welche Personen und Personengruppen welche Informationen wie und unter welchen Umständen weitergeben dürfen. Durch Zugriffsrechte kann sichergestellt werden, dass nur die Personen an Daten kommen, die auch wirklich für sie bestimmt sind. Auch in Kleinstbetrieben mit weniger als einer handvoll Mitarbeitern sind solche Richtlinien sinnvoll, um nicht in Krisensituationen in die Falle zu tappen.

- Schulungen und Trainings zur Sensibilisierung der Themenfelder Deepfaking und Social Engineering dürften für ziemlich jeden sinnvoll sein, um auch professionelle Betrugsmaschen schnellstmöglich zu durchleuten.

- Die Informationen, mit denen KIs lernen und Deepfakes erstellen, werden oft aus den sozialen Netzwerken gezogen. Überlegen Sie gut, welche Daten Sie über welche Kanäle teilen möchten und sensibilisieren Sie auch Ihre Mitarbeiter, nur das preiszugeben, was auch wirklich in alle Hände gelangen darf.

Sichern Sie Ihre Geräte! Sie sollten sowohl Firmennetzwerke und alle eingebundenen Geräte als auch private Computer, Laptops und Smartphones mit vollumfänglichen Sicherheitsmaßnahmen wie dem Antivirenschutz absichern. Wenn Sie hierbei Hilfe benötigen, wenden Sie sich gern an den PC-SPEZIALIST in Ihrer Nähe. Auch wenn Sie bereits Opfer eines Deepfaking-Angriffs geworden sind, ist ebenfalls PC-SPEZIALIST der richtige Ansprechpartner für Sie. Er wird sein Bestes geben, Ihre Firmennetzwerken, alle Ihre Firmenrechner wie auch Ihre privaten Rechner und alle Daten auf diesen zu retten!

_______________________________________________

Weiterführende Links: Bigdata-Insider, Mixed.de, Ionos, Security Insider, Wikipedia, Kaspersky, Mixed.de, Wikipedia, Brandmauer.de

Schreiben Sie einen Kommentar